汶川地震17年后,少年在交大圆了“报国梦”

MORE

近日,自动化系硕士研究生唐三立、陈明健、孙程锦(导师为杨杰、黄晓霖)在机器学习领域顶级期刊 IEEE Transactions on Pattern Analysis and Machine Intelligence发表题为Adversarial Attack Type I: Cheat Classifiers by Significant Changes的学术论文。

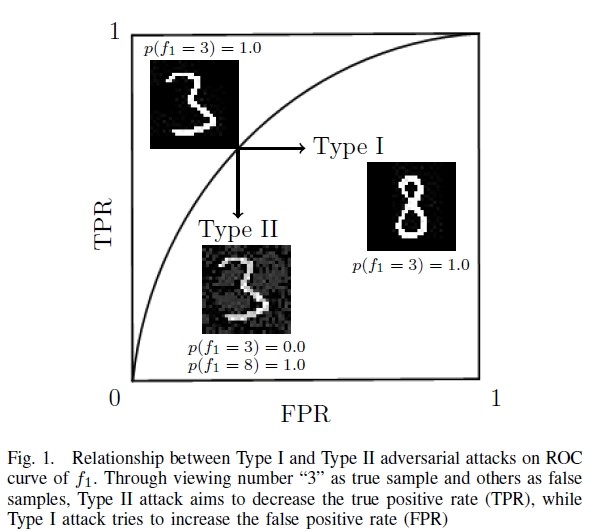

对于人工神经网络论的攻击是当前的研究热点之一,一般是利用样本微小的变化诱发神经网络的过大反应。本文提出了与已有生成攻击本质不同的一类攻击方式,即诱导样本产生巨大的变化但保持神经网络输出不变。统计上,已有的攻击目的在于增加第二类统计错误,本文提出了增加第一类错误的新型生成攻击方式。文章对两类攻击的本质进行了分析,通过实验说明针对已有攻击的防御手段对本文提出的攻击模式失效,验证了所提攻击方法与已有攻击的本质不同。在提出这类新的生成攻击方法并进行分析的基础上,论文设计了带有监督信息的变分自编码器(sVAE),在图象空间实现了 Type I 攻击;在 StyleGAN 等已有生成模型的框架下实现了隐空间的 Type I 攻击。作为与已有生成攻击平行且重要的这类新的攻击模式的实现,为进一步分析神经网络并对其进行增强,提供了有力的工具。

论文地址:https://ieeexplore.ieee.org/document/8807315/